La inteligencia artificial aún no entiende a los neandertales: un estudio desvela la brecha entre la IA y la ciencia

La inteligencia artificial promete responder a cualquier pregunta en segundos, pero cuando mira a nuestros ancestros remotos aún arrastra errores del pasado. Un nuevo estudio advierte de que los sistemas generativos reproducen estereotipos y conocimientos desactualizados sobre los neandertales, lo que evidencia la distancia que aún existe entre la IA y la ciencia actual.

Por Enrique Coperías, periodista científico

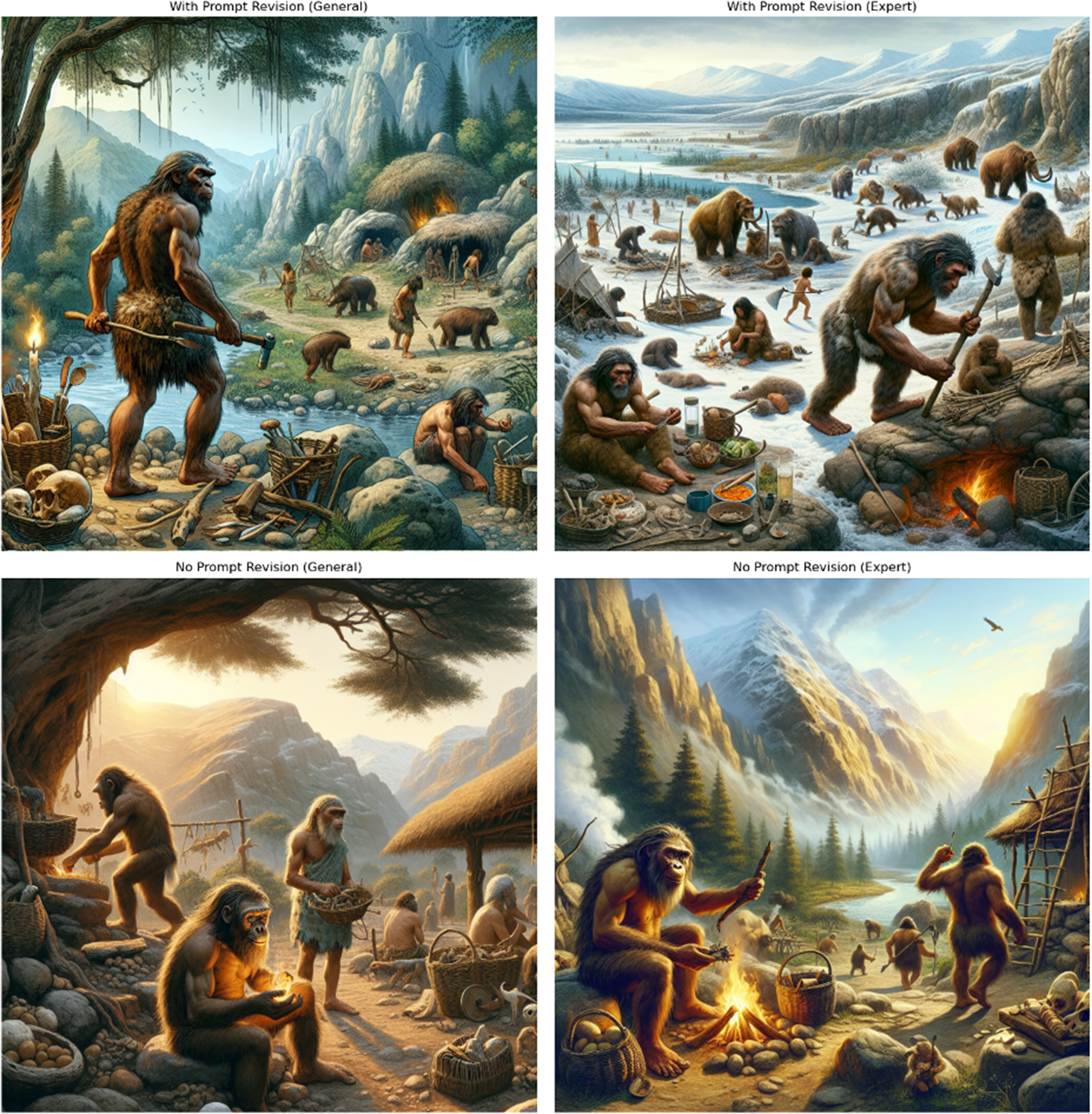

Imagen generada por inteligencia artificial con DALL-E 3 para el estudio: el encargo describía actividades, entorno y herramientas de los neandertales, pero no exigía precisión científica, un detalle que ayuda a explicar por qué estas recreaciones aún reflejan estereotipos del pasado. Cortesía: University of Maine

La inteligencia artificial (IA) generativa se ha convertido en una de las tecnologías más influyentes de la década. Produce textos, imágenes y sonidos que imitan con sorprendente realismo la creatividad humana y promete transformar campos tan diversos como la medicina, el arte y la educación.

Pero ¿qué ocurre cuando esa tecnología se adentra en el terreno del conocimiento académico y la reconstrucción del pasado? Un nuevo estudio internacional ha puesto a prueba a la IA con un objeto inesperado: los neandertales. El resultado revela una brecha notable entre lo que la ciencia sabe y lo que la inteligencia artificial cuenta.

El trabajo, publicado en la revista Advances in Archaeological Practice, analiza cómo herramientas de inteligencia artificial generativa describen y representan visualmente a los neandertales y compara esas imágenes y textos con más de un siglo de literatura científica sobre la especie.

La conclusión es contundente: existe una correspondencia baja entre el conocimiento académico actual y los contenidos generados por IA, que tienden a reproducir ideas obsoletas, estereotipos y anacronismos culturales.

Qué revela el estudio sobre la IA y los neandertales

Los autores eligieron a los Homo neanderthalensis como caso de estudio por una razón estratégica. Pocas figuras del pasado humano han cambiado tanto en la imaginación científica y popular. Desde su descubrimiento en el siglo XIX en el valle de Neander (Alemania), estos homínidos han pasado de ser retratados como criaturas torpes y brutales a considerarse parientes cercanos con capacidades cognitivas y sociales complejas.

Hoy, el consenso científico reconoce que los neandertales fabricaban herramientas sofisticadas, cuidaban a sus enfermos, utilizaban plantas medicinales y probablemente desarrollaron formas de simbolismo y cultura.

👉 Sin embargo, la imagen popular sigue anclada en clichés: seres encorvados, cubiertos de pelo y poco inteligentes. Ese contraste convierte a los neandertales en un campo ideal para medir la distancia entre ciencia actual y representación cultural.

Cómo se puso a prueba a la IA con textos e imágenes del pasado

El estudio partió de una hipótesis sencilla: si la inteligencia artificial se entrena con grandes cantidades de datos disponibles en internet —muchos de ellos desactualizados o simplificados—, es probable que sus representaciones del pasado reproduzcan esos mismos sesgos.

🗣️ «Es importante, en términos generales, examinar los tipos de sesgos que están incorporados en nuestro uso cotidiano de estas tecnologías —subraya Matthew Magnani, antropólogo del Departamento de Antropología y el Instituto del Cambio Climático, en la Universidad de Maine. Y añade—: Resulta fundamental comprender cómo las respuestas rápidas que recibimos se relacionan con el conocimiento científico más avanzado y contemporáneo. ¿Somos propensos a recibir respuestas desactualizadas cuando buscamos información en chatbots, y en qué campos?».

Para comprobarlo, los investigadores generaron cientos de imágenes y textos sobre «un día en la vida de un neandertal» utilizando modelos comerciales de IA generativa, como ChatGPT y DALL-E. Después compararon ese material con más de 2.000 resúmenes de artículos científicos publicados entre 1900 y 2023 sobre los neandertales en revistas académicas.

Imágenes generadas por IA más cercanas al promedio de los cuatro tipos de instrucciones utilizadas en el estudio: en sentido horario desde arriba, con revisión automática del prompt, con revisión experta, sin revisión experta y sin revisión del prompt. El conjunto ilustra cómo pequeños cambios en las indicaciones alteran la forma en que la inteligencia artificial imagina a los neandertales. ¿Eres capaz de detectar los errores? Cortesía: Matthew Magnani and Jon Clindaniel

Información de los 70, 80 y principios de los 90

El análisis no se limitó a una lectura subjetiva. Los autores emplearon técnicas computacionales avanzadas para medir la similitud semántica entre los contenidos generados por IA y la literatura científica.

En esencia, convirtieron textos e imágenes en vectores matemáticos y calcularon la distancia entre ellos. Esto permitió estimar a qué época del conocimiento académico se parecían más las representaciones artificiales.

El resultado fue revelador: los textos generados por IA se alineaban, de media, con la literatura científica de principios de los años sesenta; las imágenes, con la de finales de los ochenta y principios de los noventa. Es decir, la inteligencia artificial tendía a reproducir versiones del conocimiento científico con varias décadas de antigüedad.

Estereotipos antiguos y errores históricos en las respuestas de la IA

Las imágenes producidas por IA mostraban neandertales con rasgos exagerados —frentes bajas, cejas prominentes, abundante vello corporal— más propios de ilustraciones de principios del siglo XX que de reconstrucciones científicas actuales. En muchas escenas aparecían hombres musculosos cazando, mientras mujeres y niños apenas figuraban, lo que refleja una visión de género igualmente desfasada.

Además, surgieron anacronismos llamativos. Algunas representaciones incluían cestas elaboradas, chozas con tejados de paja, escaleras o recipientes de vidrio y metal: tecnologías que no existieron hasta decenas de miles de años después de la desaparición de los neandertales.

En contraste, los textos generados por IA eran menos espectaculares, pero igualmente simplificados. Describían comunidades centradas en la caza, el refugio en cuevas y la supervivencia diaria, con escasa mención a la complejidad cultural o tecnológica documentada por la arqueología reciente.

La vida neandertal aparecía como una rutina homogénea y rudimentaria, más cercana a manuales escolares de mediados del siglo XX que a la investigación contemporánea.

El papel de los datos científicos en los errores de la IA generativa

¿Por qué la inteligencia artificial ofrece una imagen tan desactualizada? La explicación se encuentra en el origen de sus datos de entrenamiento. Los sistemas generativos aprenden a partir de enormes repositorios digitales: páginas web, imágenes, libros digitalizados y otros contenidos disponibles en línea. Pero la distribución de ese conocimiento no es uniforme.

Gran parte de la literatura científica reciente está protegida por derechos de autor o detrás de muros de pago, lo que limita su presencia en los conjuntos de datos accesibles. En cambio, materiales antiguos, divulgativos o populares —a menudo basados en teorías ya superadas— circulan libremente por internet.

El resultado es un sesgo temporal: la IA bebe más de fuentes antiguas o simplificadas que de investigaciones actuales.

Sesgos invisibles: cuando la IA hereda las ideas del pasado

El propio estudio muestra cómo la disponibilidad de datos académicos condiciona el análisis. Los investigadores solo pudieron acceder a un número limitado de artículos completos y recurrieron principalmente a resúmenes, ya que muchos textos recientes están restringidos por copyright.

Esa misma limitación, señala Magnani, probablemente afecta a los sistemas de inteligencia artificial.

🗣️ En palabras del otro autor del estudio, Jon Clindaniel, del Centro de Ciencias Sociales Computacionales de Chicago, en la Universidad de Chicag, «una forma importante de lograr resultados de IA más precisos es trabajar para garantizar que los conjuntos de datos antropológicos y los artículos académicos sean accesibles para la IA».

Qué significa este estudio para el futuro de la ciencia y la tecnología

Cuando se habla de sesgos en la inteligencia artificial, la atención suele centrarse en cuestiones como el racismo o el sexismo en los algoritmos. Sin embargo, este trabajo revela otro tipo de distorsión menos visible pero igualmente relevante: la reproducción de conocimientos obsoletos.

La IA no solo puede replicar prejuicios sociales; también puede perpetuar ideas científicas superadas, visiones simplificadas de la historia o narrativas culturales dominantes. En el caso de los neandertales, la tecnología revive una imagen que la arqueología y la paleoantropología llevan décadas revisando.

Este fenómeno tiene implicaciones más amplias. Si, como predicen algunos expertos, una parte creciente del contenido en internet será generado por inteligencia artificial, existe el riesgo de que esos errores se retroalimenten. Las representaciones inexactas podrían multiplicarse y convertirse en nuevas fuentes de entrenamiento para futuros sistemas, reforzando de este modo una espiral de desinformación.

La batalla por el control del conocimiento en la era de la IA

La representación del pasado nunca ha sido neutral. Museos, libros de texto, películas y documentales han contribuido a construir imágenes colectivas de la prehistoria, a menudo influenciadas por ideologías contemporáneas. La inteligencia artificial se suma ahora a ese proceso como un nuevo agente cultural.

Por un lado, estas herramientas democratizan la creación visual y narrativa: cualquiera puede generar escenas del pasado sin formación especializada. Por otro, esa facilidad puede amplificar estereotipos o errores históricos a gran escala.

El estudio propone adoptar una actitud introspectiva desde disciplinas como la arqueología y la antropología. Es decir, analizar críticamente cómo la IA construye el pasado y participar activamente en el diseño de sus datos y modelos. La solución no pasa por rechazar la tecnología, sino por comprender sus limitaciones y corregir sus sesgos.

🗣️ Como resume Clindaniel, «la IA puede ser una gran herramienta para procesar grandes volúmenes de información y encontrar patrones, pero es necesario utilizarla con habilidad y atención para garantizar que esté basada en el registro científico».

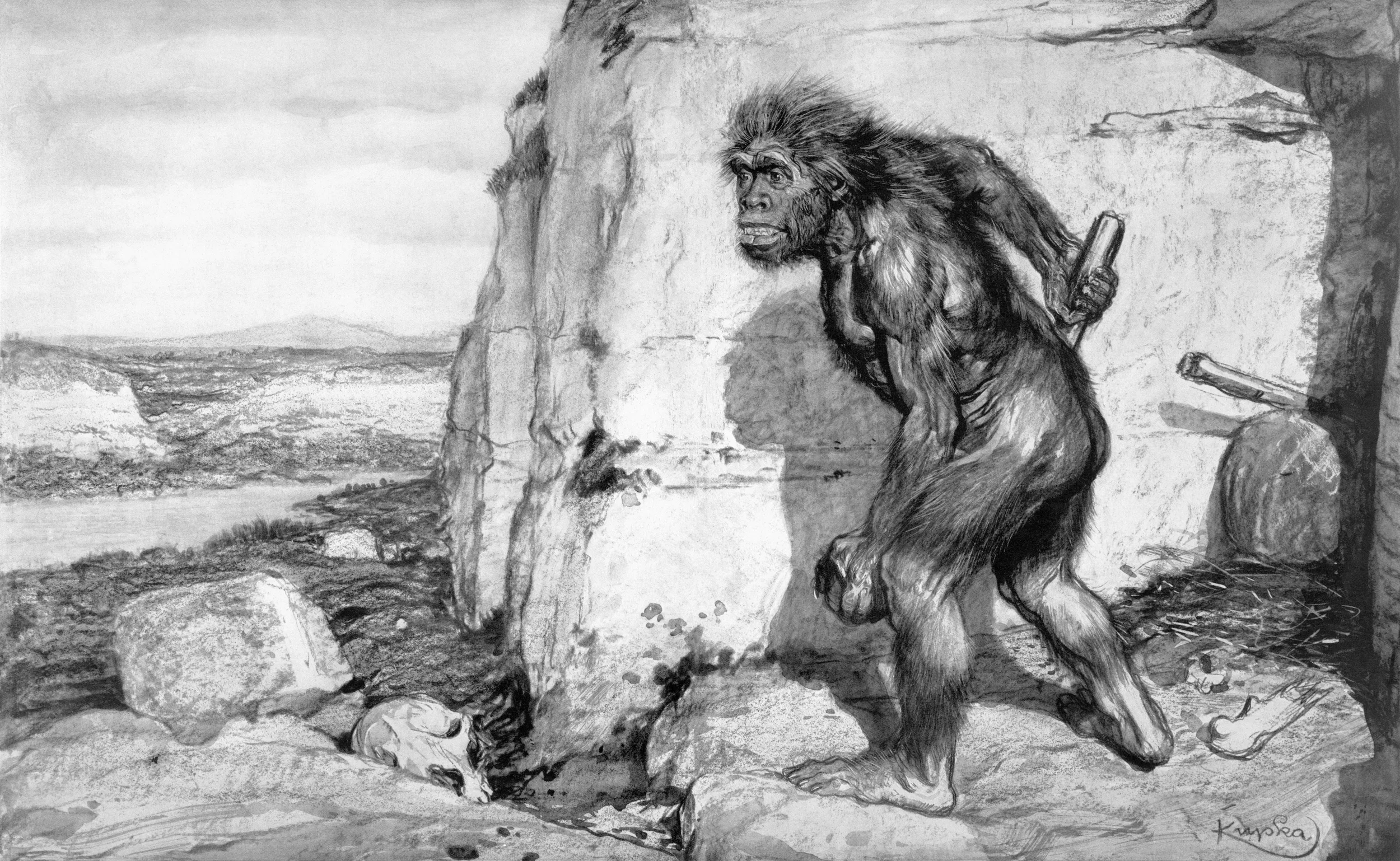

Ilustración de 1909 del neandertal de La Chapelle-aux-Saints, dibujada por František Kupka a partir de la interpretación científica de Marcellin Boule. Más de un siglo después, la inteligencia artificial sigue imaginando a los neandertales de forma sorprendentemente parecida a estas visiones del pasado.

Cómo evitar que la IA distorsione la historia y el conocimiento científico

Más allá de la arqueología, la investigación plantea preguntas de fondo sobre la relación entre inteligencia artificial y conocimiento académico. ¿Qué ocurre cuando millones de personas consultan sistemas que sintetizan información de manera automática? ¿Cómo se garantiza que ese conocimiento sea actualizado y riguroso?

La respuesta depende, en gran medida, de la infraestructura del conocimiento. El acceso abierto a la investigación científica, la transparencia en los datos de entrenamiento y la colaboración entre desarrolladores y académicos serán factores clave para reducir la brecha detectada.

Los autores sugieren que su metodología puede aplicarse a otros ámbitos: desde la representación de culturas indígenas hasta la historia reciente o la ciencia médica. En todos los casos, medir la distancia entre lo que dice la IA y lo que sabe la comunidad científica permitirá detectar distorsiones y corregirlas.

«Nuestro estudio ofrece un modelo para que otros investigadores examinen la distancia entre el conocimiento académico y el contenido generado mediante inteligencia artificia», afirma Magnani.

El futuro de la memoria digital en manos de la inteligencia artificial

La inteligencia artificial no solo produce contenido: también moldeará la memoria colectiva. Si las herramientas generativas se convierten en mediadoras habituales del conocimiento, influirán en cómo imaginamos el pasado y, en última instancia, en cómo entendemos el presente.

El caso de los neandertales muestra que esa influencia ya está en marcha. Entre la cueva y el algoritmo, la distancia es menor de lo que parece. Pero también revela que la tecnología, por sí sola, no garantiza precisión ni rigor. Sin un diálogo constante con la investigación académica, la IA corre el riesgo de convertirse en una máquina de repetir viejos errores.

La pregunta, entonces, no es solo qué puede hacer la IA por la ciencia, sino qué debe hacer la ciencia para guiar a la inteligencia artificial. En esa tensión entre innovación tecnológica y conocimiento acumulado se juega, en buena medida, la calidad de la información que definirá el mundo digital de las próximas décadas.

Como advierte Magnani, «enseñar a nuestros estudiantes a abordar la inteligencia artificial generativa con cautela dará lugar a una sociedad más alfabetizada tecnológicamente y más crítica». ▪️(7-febrero-2026)

Información facilitada por la Universidad de Maine

Fuente: Magnani M, Clindaniel J. Artificial Intelligence and the Interpretation of the Past. Advances in Archaeological Practice (2025). DOI:10.1017/aap.2025.10110