Monos que navegan con la mente: el salto definitivo de las interfaces cerebro-ordenador hacia el mundo real

Monos que se mueven por un bosque virtual sin dar un solo paso: la ciencia convierte la actividad cerebral en navegación realista. Estamos ante un avance que acerca las interfaces cerebro-ordenador a su gran promesa: devolver autonomía a quienes no pueden moverse.

Por Enrique Coperías, periodista científico

Imagen conceptual de macaco equipado con un implante neuronal observando un entorno virtual que controla con su actividad cerebral, en un experimento que traduce señales del cerebro en navegación en tiempo real. Crédito: IA-Nano Banana 2-RexMolón Producciones

Un gran avance en neurotecnología aplicada

En algún lugar entre la ciencia ficción y la rehabilitación neurológica, tres macacos avanzan por un bosque que no existe. Es un bosque digital, poblado de árboles virtuales y montañas sintéticas. No caminan. No mueven los brazos. Ni siquiera hacen el gesto de desplazarse. Sin embargo, avanzan. Pero ¿cómo?

Lo hacen únicamente con la actividad de sus neuronas, traducida en órdenes que una máquina convierte en movimiento. Es la escena, tan fascinante como inquietante, que describe un nuevo estudio publicado en la revista Science Advances, y que marca un paso más en la ambición de las interfaces cerebro-ordenador: sacar esta tecnología del laboratorio y acercarla a la vida cotidiana.

Recordemos que las interfaces cerebro-ordenador, conocidas como BCI por sus siglas en inglés (brain-computer interfaces), son sistemas que permiten establecer una comunicación directa entre la actividad neuronal y dispositivos externos, sin necesidad de movimiento físico. A través de sensores que registran señales del cerebro, ya sea de forma invasiva o no invasiva, estas tecnologías traducen patrones neuronales en órdenes que pueden controlar un cursor, una prótesis o incluso un entorno virtual, con el objetivo de restaurar funciones perdidas o ampliar las capacidades humanas.

Qué es una interfaz cerebro-ordenador intracortical

La investigación, liderada por científicos de la Universidad de Lovaina, en Bélgica, presenta un sistema capaz de convertir señales cerebrales en navegación tridimensional dentro de entornos virtuales complejos. No se trata ya de mover un cursor en una pantalla plana o accionar un brazo robótico en condiciones controladas. Aquí, los macacos aprenden a desplazarse en un espacio tridimensional cambiante, con obstáculos, objetivos móviles y perspectivas dinámicas, todo ello sin mover un músculo de su cuerpo.

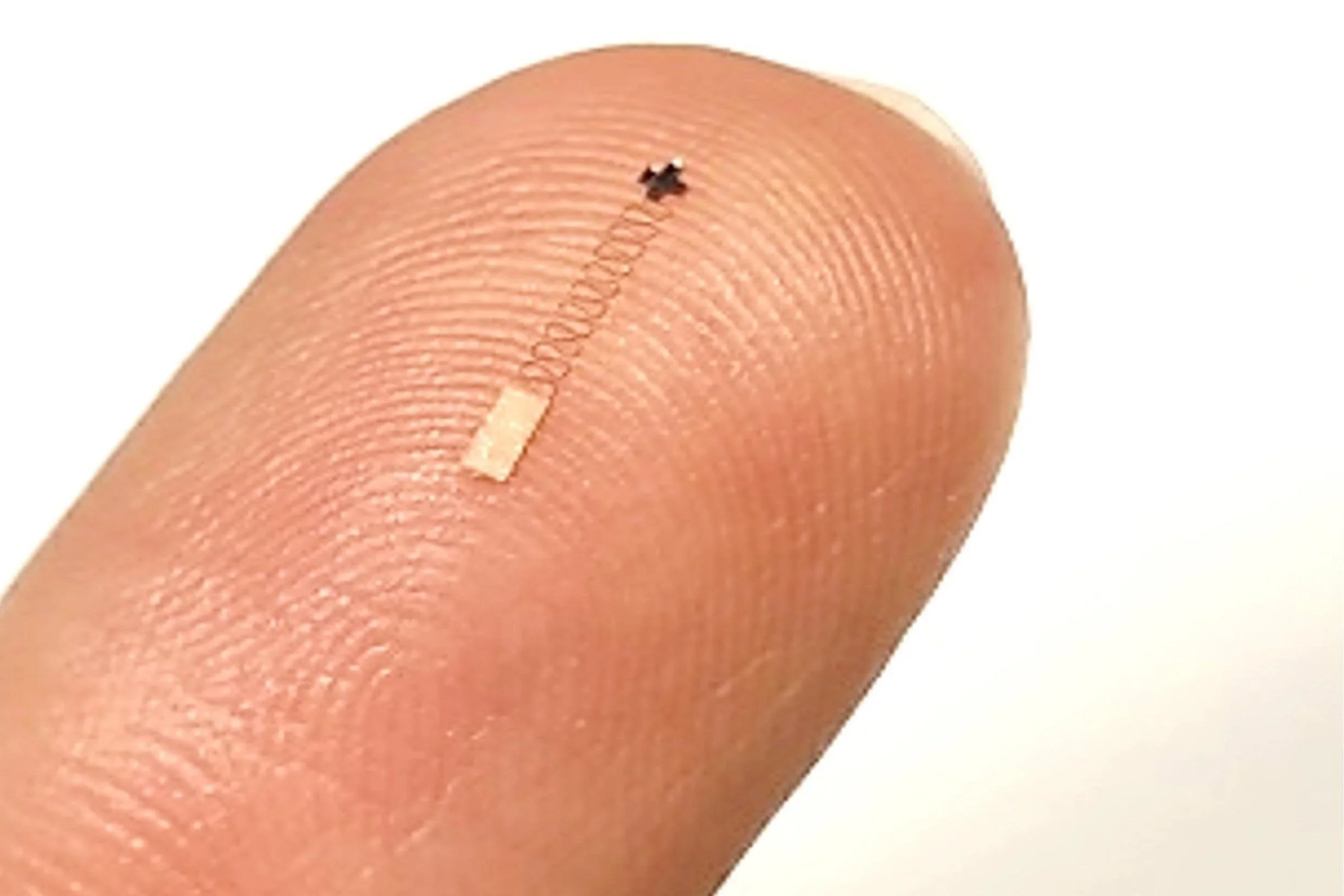

El secreto de esta proeza está en lo que los investigadores denominan una interfaz cerebro-ordenador intracortical. A diferencia de dispositivos no invasivos, como los que se basan en electroencefalografía, este sistema utiliza microelectrodos implantados directamente en el cerebro.

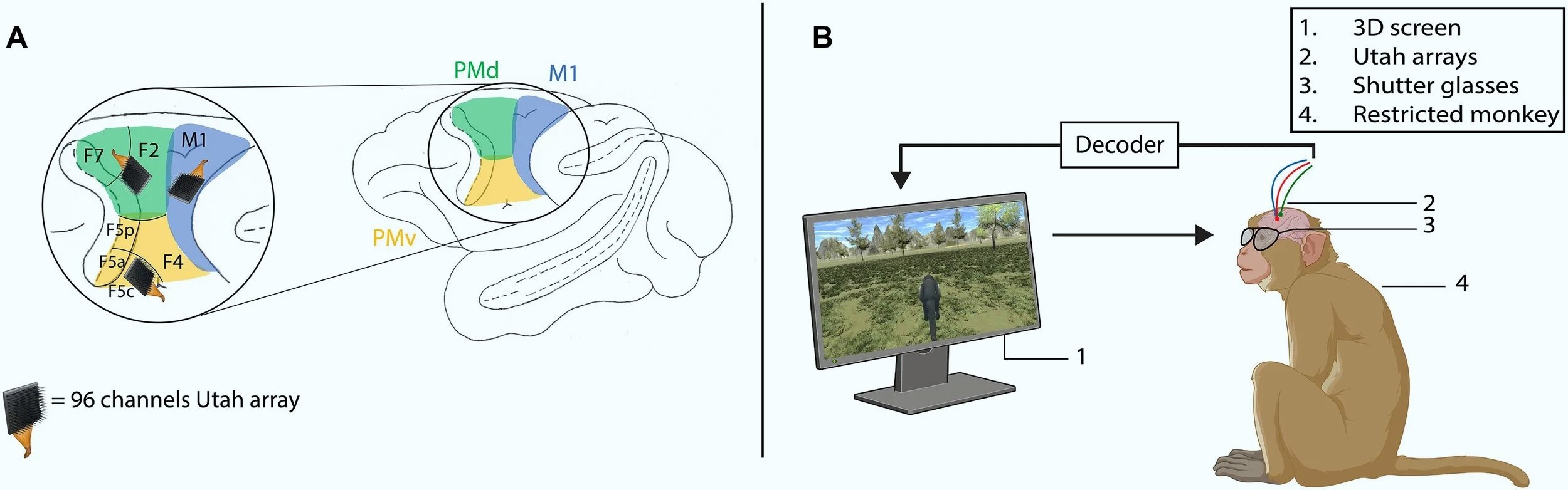

En este caso, los electrodos llegan a tres regiones implicadas en el control del movimiento: la corteza motora primaria y dos áreas premotoras, la vantral y la dorsal. Desde allí, el interfaz recoge la actividad de cientos de neuronas y la traduce en comandos de velocidad en tres dimensiones.

Avatar movido por las neuronas de un mono

Un macaco navega por un entorno virtual en primera persona controlando su movimiento únicamente mediante actividad cerebral, durante la fase de decodificación en tiempo real del experimento. Cortesía: Saussus et al. / Science Advances

Monos que controlan un avatar

Lo verdaderamente novedoso de este trabajo, dirigido por Peter Janssen, del Laboratorio de Neurofisiología y Psicofisiología, en el Departamento de Neurociencias de Lovaina, no es solo la precisión del sistema, sino su contexto. Hasta ahora, muchos experimentos de este tipo se habían limitado a entornos simplificados: un punto que se mueve en una pantalla, una trayectoria lineal o tareas repetitivas.

Aquí, en cambio, los monos navegan por escenarios virtuales que imitan situaciones del mundo real. En uno de los experimentos más llamativos, controlan un avatar, esto es, una representación digital de sí mismos, que se desplaza por un bosque virtual, con la cámara siguiendo sus movimientos como si se tratara de un videojuego en tercera persona.

Y lo hacen sorprendentemente bien. En algunas tareas, los animales alcanzan tasas de éxito de hasta el 96%, muy por encima del azar. Incluso cuando el entorno se vuelve más complejo, con objetivos que cambian de posición a mitad del recorrido o con obstáculos que obligan a desviarse, los monos son capaces de adaptarse y completar la tarea con notable eficacia. No solo reaccionan: ¡anticipan, corrigen y ajustan sus trayectorias en tiempo real!

Lo novedoso: un entrenamiento pasivo

Uno de los aspectos más llamativos del estudio es cómo se entrena el sistema. A diferencia de otras investigaciones, en las que los sujetos deben aprender a controlar el dispositivo mediante ensayo y error, a menudo con movimientos físicos o intentos de movimiento, aquí el entrenamiento es pasivo. Durante unos minutos, los macacos simplemente observan cómo una esfera se mueve por el entorno virtual. Mientras tanto, el sistema registra la actividad cerebral asociada a esa observación y aprende a relacionarla con las trayectorias del movimiento.

Después, sin necesidad de recalibrar el modelo ni de realizar nuevos entrenamientos, los animales pasan a controlar el sistema directamente con su actividad neuronal. Es decir, el cerebro se adapta al dispositivo, no al revés. Esta inversión de la lógica tradicional es una de las claves del avance. Según Janssen y sus colegas, sugiere que el sistema nervioso puede reorganizarse rápidamente para interactuar con una máquina, incluso en ausencia de movimiento físico.

El experimento también arroja luz sobre cómo el cerebro organiza la información necesaria para moverse en el espacio. Contra lo que cabría esperar, las áreas premotoras, implicadas en la planificación del movimiento, resultaron más informativas que la corteza motora primaria, tradicionalmente asociada a la ejecución. Esto sugiere que la intención de movimiento, más que el movimiento en sí, puede ser la clave para desarrollar interfaces más eficaces.

Esquema del experimento: a la izquierda, la localización de los implantes cerebrales en áreas motoras y premotoras; a la derecha, el sistema en bucle cerrado que permite al mono, inmovilizado y con gafas estereoscópicas, navegar por un entorno virtual en 3D mediante su actividad neuronal. Cortesía: Saussus et al. (Science Advances)

El factor decisivo: el bucle cerrado cerebro-máquina

Pero quizá el hallazgo más importante no esté en los números, sino en el comportamiento. Los macacos no se limitan a ejecutar órdenes. Aprenden. Mejoran con la práctica. Ajustan su actividad neuronal en función del resultado de sus acciones. En otras palabras, establecen un bucle cerrado cerebro-máquina, en el que la retroalimentación visual permite refinar el control. Y ese bucle, en el que la retroalimentación visual permite refinar el control, parece ser esencial para el rendimiento del sistema.

De hecho, cuando los investigadores compararon el rendimiento del sistema en tiempo real con simulaciones offline, en las que se reproducen las señales neuronales sin interacción, observaron una diferencia significativa.

El control en vivo era claramente superior. La conclusión es que la interacción continua con el entorno, aunque sea virtual, es fundamental para que el cerebro optimice su respuesta.

Aplicaciones reales: hacia la autonomía de personas con parálisis

Las implicaciones de este trabajo van más allá del laboratorio. Uno de los objetivos explícitos del estudio es desarrollar tecnologías que puedan mejorar la vida de personas con parálisis. En ese contexto, la capacidad de controlar un entorno complejo sin necesidad de movimiento físico es especialmente relevante.

Los autores mencionan aplicaciones como el control de sillas de ruedas, prótesis o sistemas de comunicación.

El hecho de que el sistema funcione sin necesidad de recalibraciones frecuentes y que pueda adaptarse a distintos entornos y tareas lo acerca a un uso más práctico. También es importante que el control no dependa de señales musculares residuales, algo que los investigadores comprobaron midiendo la actividad electromiográfica. Esto refuerza su potencial en pacientes con parálisis completa.

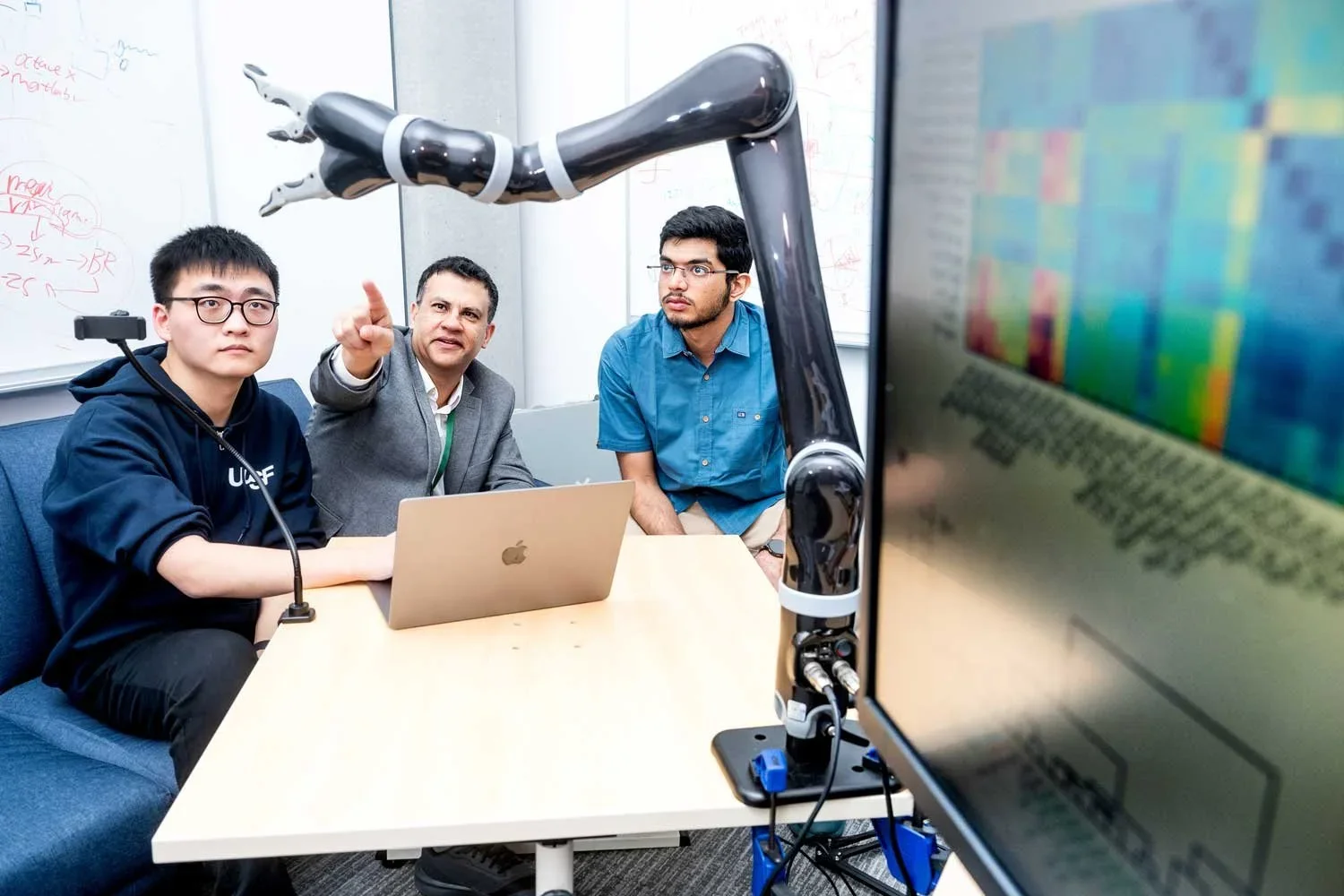

El neurocientífico Karunesh Ganguly (centro) y su equipo investigan cómo traducir señales cerebrales en movimiento mediante un brazo robótico, un enfoque clave en el desarrollo de interfaces cerebro-ordenador aplicadas a la rehabilitación. Foto: Noah Berger

Limitaciones actuales

Sin embargo, todavía hay un largo camino por recorrer. El sistema requiere implantes cerebrales invasivos, con los riesgos y limitaciones que ello implica. Además, aunque los resultados en monos son prometedores, su traducción a humanos plantea desafíos técnicos, éticos y regulatorios. No es lo mismo navegar por un bosque virtual que moverse por una casa real, con todas sus imprevisibilidades.

Aun así, el estudio representa un cambio de paradigma. Hasta ahora, las interfaces cerebro-ordenador se habían desarrollado en entornos controlados, con tareas simples y condiciones predecibles. Este trabajo demuestra que es posible dar el salto a escenarios más complejos, en los que la flexibilidad, la adaptación y la generalización son esenciales.

En cierto modo, lo que vemos aquí no es solo una tecnología que traduce pensamientos en acciones, sino un sistema híbrido en el que cerebro y máquina aprenden juntos. Los monos no solo usan la interfaz: la incorporan. Y en ese proceso, redefinen los límites de lo que entendemos por control, movimiento y autonomía.

Quizá dentro de unos años, personas con parálisis puedan desplazarse por su casa —o por entornos virtuales— con la misma naturalidad con la que hoy movemos un ratón. Si eso ocurre, será en parte gracias a estos experimentos en los que tres monos, sentados frente a una pantalla, aprendieron a caminar sin moverse.▪️(17-abril-2026)

PREGUNTAS&RESPUESTAS: Interfaces cerebro-ordenador y Monos

🐒 ¿Qué han conseguido exactamente los científicos en este estudio?

Han demostrado que monos pueden navegar por un entorno virtual tridimensional utilizando únicamente su actividad cerebral, sin mover el cuerpo, lo que supone un avance hacia aplicaciones reales de las interfaces cerebro-ordenador.

🐒 ¿Cómo pueden los monos moverse sin usar sus músculos?

Mediante implantes que registran la actividad neuronal, un sistema informático traduce esas señales en órdenes de movimiento dentro de un entorno virtual, como si el cerebro controlara directamente un avatar.

🐒 ¿Qué diferencia este experimento de otros anteriores?

A diferencia de estudios previos más simples, aquí los animales se desenvuelven en entornos complejos y dinámicos, con obstáculos y objetivos cambiantes, más parecidos a situaciones del mundo real.

🐒 ¿Para qué podría servir esta tecnología en humanos?

Podría permitir a personas con parálisis controlar sillas de ruedas, prótesis o sistemas de comunicación directamente con el cerebro, recuperando parte de su autonomía.

🐒 ¿Es necesario implantar dispositivos en el cerebro?

En este estudio sí, ya que los implantes permiten una lectura muy precisa de la actividad neuronal. Existen alternativas no invasivas, pero todavía son menos eficaces.

🐒 ¿Cuándo podría aplicarse en la vida cotidiana?

Aunque los avances son prometedores, todavía se necesitan más investigaciones y ensayos clínicos antes de que estas tecnologías estén disponibles de forma generalizada.

NEUROTECNOLOGÍA

Fuente: Ophelie Saussus et al. Intracortical brain-computer interface for navigation in virtual reality in macaque monkeys.Science Advances (2026). DOI: 10.1126/sciadv.adw3876