Cómo los perros están enseñando a los robots a buscar objetos

Investigadores de la Universidad de Brown han desarrollado un sistema de inteligencia artificial que permite a los robots encontrar objetos combinando lenguaje humano, gestos y visión. El sistema está inspirado en la forma en que los perros interpretan nuestros gestos de señalar.

Por Enrique Coperías, periodista científico

Imagen conceptual de un científico señalando una taza mientras un perro y un robot cuadrúpedo observan el mismo objetivo: los investigadores se inspiran en la capacidad de los perros para interpretar gestos humanos y mejorar la búsqueda de objetos en robots. Crédito: IA-DALL-E-RexMolón Producciones

Imagina la escena: alguien le pide a un robot que busque una taza en una habitación desordenada. Dice «la taza», pero hay varias. Entonces levanta el brazo y señala hacia una esquina. El robot debe interpretar ambas pistas —la palabra y el gesto— para saber cuál es la taza correcta que ha de coger.

A simple vista, parece una acción trivial para cualquier humano. Incluso para un perro entrenado. Pero para un robot es uno de los problemas más complejos de la robótica moderna.

Un nuevo trabajo de investigadores de la Universidad Brown, en Estados Unidos, explora precisamente esta cuestión: cómo pueden los robots aprender a combinar lenguaje y gestos humanos para localizar objetos en entornos reales, donde la información siempre es incompleta y ambigua. El estudio presenta un sistema llamado LEGS-POMDP, que ha sido diseñado para integrar tres fuentes de información: lenguaje, gestos y visión. Y las utiliza conjuntamente para encontrar objetos en espacios parcialmente desconocidos.

La inspiración es simple: los seres humanos no nos comunicamos solo con palabras. De hecho, los gestos suelen ser decisivos para aclarar lo que queremos expresar.

El desafío de entender instrucciones humanas

Para un robot, seguir instrucciones humanas implica resolver dos incógnitas al mismo tiempo. Primero debe deducir qué objeto buscamos exactamente. Segundo, dónde está.

Ambas cosas pueden ser ambiguas. El lenguaje puede ser vago —la taza podría referirse a varias— y los gestos tampoco son perfectos: un dedo apuntando puede señalar una región general, no un objeto concreto. Además, la percepción de los sensores del robot añade ruido e incertidumbre.

El problema se agrava en entornos abiertos o desordenados, como una casa o una oficina. Allí hay múltiples objetos similares, obstáculos y zonas que el robot todavía no ha explorado. Según explican los autores, el robot debe razonar de manera constante con información incompleta y actualizar sus creencias sobre el mundo a medida que obtiene nuevas pistas.

Ese proceso recuerda más a la forma en que los animales exploran su entorno que a un cálculo simple.

🗣️ «Buscar objetos obliga a un robot a desplazarse por entornos amplios —explica Ivy He, estudiante de doctorado en Brown y autora principal del estudio. Y añade—: Con la tecnología actual, los robots son bastante buenos identificando objetos, pero cuando el entorno está desordenado, las cosas se mueven o quedan ocultas por otros objetos, la tarea se vuelve mucho más difícil. Por eso este trabajo trata de utilizar tanto el lenguaje como los gestos para ayudar en esa tarea de búsqueda».

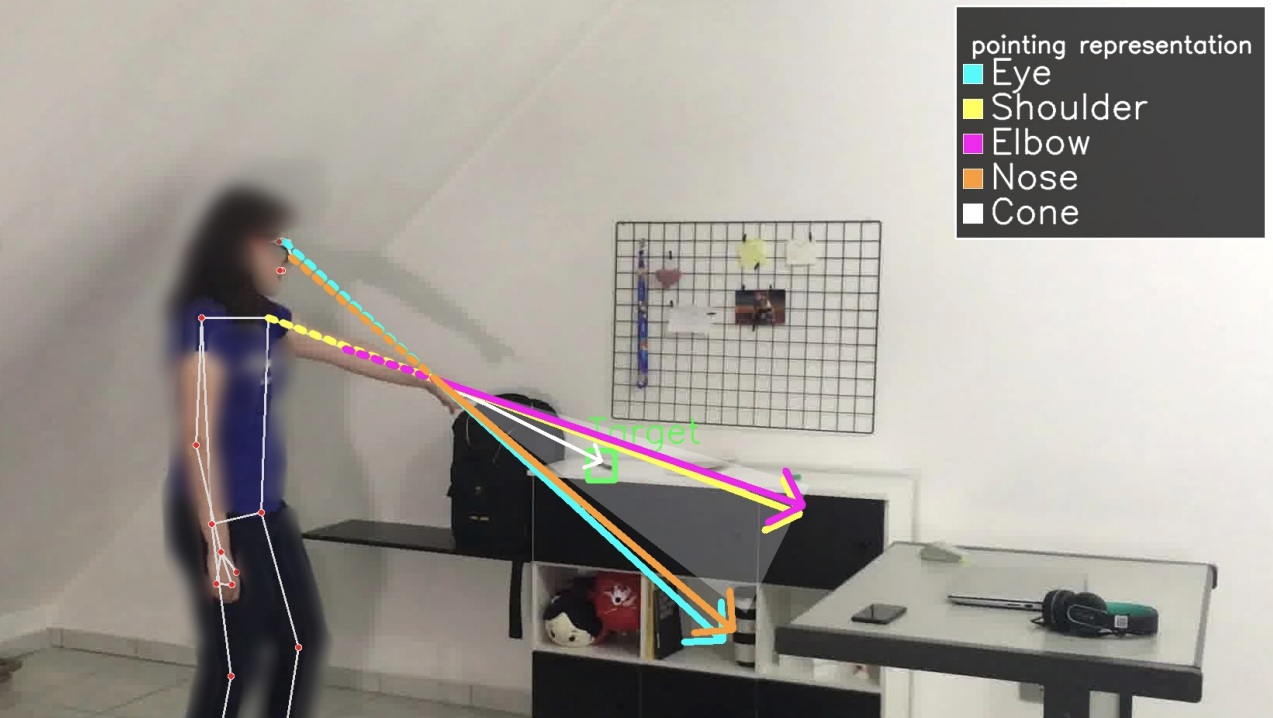

Un nuevo sistema que ayuda a los robots a localizar objetos combina pistas del lenguaje humano y gestos como señalar. Cortesía: Tellex Lab / Brown University

Robots que piensan en probabilidades

El sistema propuesto, que se explica en un artículo subido a arXiv, se basa en una técnica clásica de inteligencia artificial (IA) llamada POMDP (procesos de decisión de Markov parcialmente observables). En esencia, es un marco matemático que permite tomar decisiones cuando el agente —en este caso, el robot— no conoce completamente el estado del mundo.

El robot mantiene una especie de mapa mental probabilístico, esto es, una estimación de dónde podría estar el objeto buscado y cuál podría ser. Cada nueva pista —una palabra, un gesto o una observación visual— modifica esa estimación.

El sistema LEGS-POMDP integra tres fuentes de información:

1️⃣ Lenguaje: las palabras que utiliza la persona para describir el objeto.

2️⃣ Gestos: especialmente el gesto de señalar con la mano.

3️⃣ Visión: lo que detectan las cámaras del robot.

Cada una aporta una probabilidad sobre qué objeto podría ser el objetivo. Luego el robot combina todas esas probabilidades para decidir qué hacer a continuación: avanzar, mirar en otra dirección o confirmar que ha encontrado el objeto.

En otras palabras, el robot no interpreta las instrucciones como verdades absolutas, sino como pistas imperfectas que debe combinar.

El poder de señalar

Uno de los hallazgos más interesantes del estudio es la importancia del gesto de señalar.

Para analizarlo, los investigadores evaluaron diferentes formas de interpretar ese gesto utilizando datos del conjunto YouRefIt, que contiene miles de ejemplos de personas señalando objetos mientras los describen.

La forma más simple consiste en trazar una línea desde la mano hacia delante. Pero en la práctica, las personas señalan de maneras muy distintas: con el brazo completamente extendido, con el codo doblado o incluso con un gesto impreciso.

Para capturar esa variabilidad, los científicos diseñaron un modelo decono de señalamiento: en lugar de una línea, el gesto se interpreta como una región espacial probable. El sistema calcula la dirección media del gesto utilizando varias referencias del cuerpo —como el hombro, el codo o la muñeca— y genera un cono en el espacio donde es más probable que esté el objeto señalado.

🗣️ «Lo que hemos descubierto es que los humanos utilizan la mirada para alinearla con aquello que están señalando —explica He. Y añade—: Por eso resultó natural crear un cono basado en una línea que conecta el ojo, el codo y la muñeca. Ese modelo resulta ser una aproximación bastante buena de hacia dónde está señalando una persona».

El resultado fue sorprendente. Este modelo redujo significativamente el error angular y aumentó la precisión al identificar el objeto correcto.

La conclusión es clara: señalar no es un gesto preciso, pero contiene suficiente información para guiar la búsqueda de objetos si se interpreta correctamente.

Cuando palabras y gestos se complementan

El estudio también confirma algo que cualquiera reconoce en la comunicación humana cotidiana: las palabras y los gestos se complementan.

Cuando los robots utilizaban solo el lenguaje, acertaban en torno al 71 % de los casos. Cuando solo seguían el gesto, el éxito bajaba ligeramente al 62 %. Pero cuando combinaban ambos tipos de información, la tasa de éxito subía hasta casi el 89 %.

Además, el robot encontraba el objeto más rápido.

Esto ocurre porque cada modalidad resuelve las ambigüedades de la otra. El lenguaje puede especificar la categoría —la taza roja— mientras que el gesto indica la región aproximada donde buscar.

Cuando una de las pistas es errónea, el sistema puede compensarlo con las otras. Sin embargo, si ambas se contradicen, el robot se confunde fácilmente. En esos casos la probabilidad de éxito se desploma.

Ejemplo que muestra distintos modelos vectoriales y basados en cono para interpretar la dirección del gesto de señalar, con el objeto objetivo marcado en verde. Cortesía: Tellex Lab / Brown University

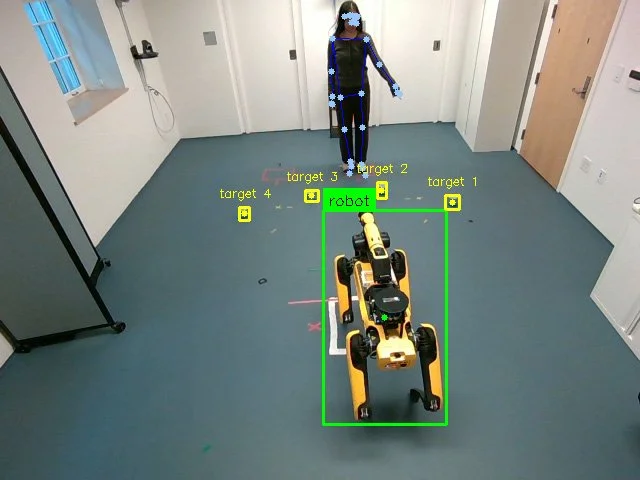

Un robot cuadrúpedo como banco de pruebas

Los investigadores no se limitaron a simulaciones. También probaron el sistema en un robot real: un robot cuadrúpedo móvil similar a los que se utilizan en exploración robótica o inspección industrial.

En los experimentos, el robot debía encontrar objetos en un espacio con varios distractores —por ejemplo, varias tazas idénticas— mientras una persona le daba instrucciones verbales y señalaba hacia la zona donde estaba el objeto correcto.

El resultado fue que el robot reducía rápidamente la incertidumbre sobre el objetivo cuando podía combinar gestos y palabras. En las pruebas, la incertidumbre disminuía más del 60 % tras unas pocas observaciones multimodales.

En cambio, si el robot solo contaba con información visual o verbal, el proceso era mucho más lento.

Qué pueden aprender los robots de los perros

Curiosamente, esta investigación conecta con algo que ya sabemos desde hace años en el estudio del comportamiento animal: los perros entienden los gestos humanos sorprendentemente bien.

Numerosos experimentos han demostrado que incluso cachorros muy jóvenes son capaces de seguir el gesto de señalar para encontrar comida escondida. Algunos investigadores creen que esta habilidad surgió durante la domesticación, al adaptarse los perros a la comunicación humana.

Los robots, en cambio, todavía están aprendiendo esa habilidad básica. La diferencia no está solo en la percepción visual, sino en la interpretación contextual. Los perros —y los humanos— entienden que señalar es una pista probabilística: no indica un punto exacto, sino una intención.

🗣️ «Nuestro trabajo en el Brown Dog Lab ha demostrado lo sofisticados que son los perros cuando se comunican con los humanos. Nos han ayidaddo a resolver muchos de los problemas de cooperación que queremos que también resuelvan los robots —explica Daphna Buchsbaum, profesora asociada de ciencias cognitivas en Brown —. Eso los convierte en un modelo natural de cooperación humano-máquina».

Para Buchsbaum, «este trabajo traduce la comprensión intuitiva que tienen los perros de la mirada y el gesto de señalar en un modelo probabilístico, lo que permite al robot manejar la ambigüedad de la comunicación humana. Nos acerca un poco más a asistentes robóticos intuitivos”.

El nuevo método modela el gesto humano de señalar como un cono que abarca los posibles objetos de interés. Cortesía: Tellex Lab / Brown University

Robots que colaboran con los seres humanos

Las implicaciones van mucho más allá de encontrar una taza en una mesa. Los robots que trabajan con seres humanos, como los que realizan tareasen hogares, hospitales, almacenes y misiones de rescate, necesitarán entender instrucciones incompletas y adaptarse a ellas en tiempo real.

Un robot asistente doméstico, por ejemplo, podría responder a una frase como: Tráeme ese libro, acompañada de un gesto hacia una estantería.

En un entorno industrial, un operario podría indicar rápidamente una pieza con el dedo sin tener que formular una descripción detallada.

«El marco que hemos desarrollado ayuda a allanar el camino hacia una interacción multimodal fluida entre humanos y robots —dice Jason Liu, coautor del estudio. Y añade—: En el futuro podremos comunicarnos con nuestros robots asistentes del mismo modo en que las personas interactúan entre sí: mediante lenguaje, gestos, mirada, demostraciones y mucho más».

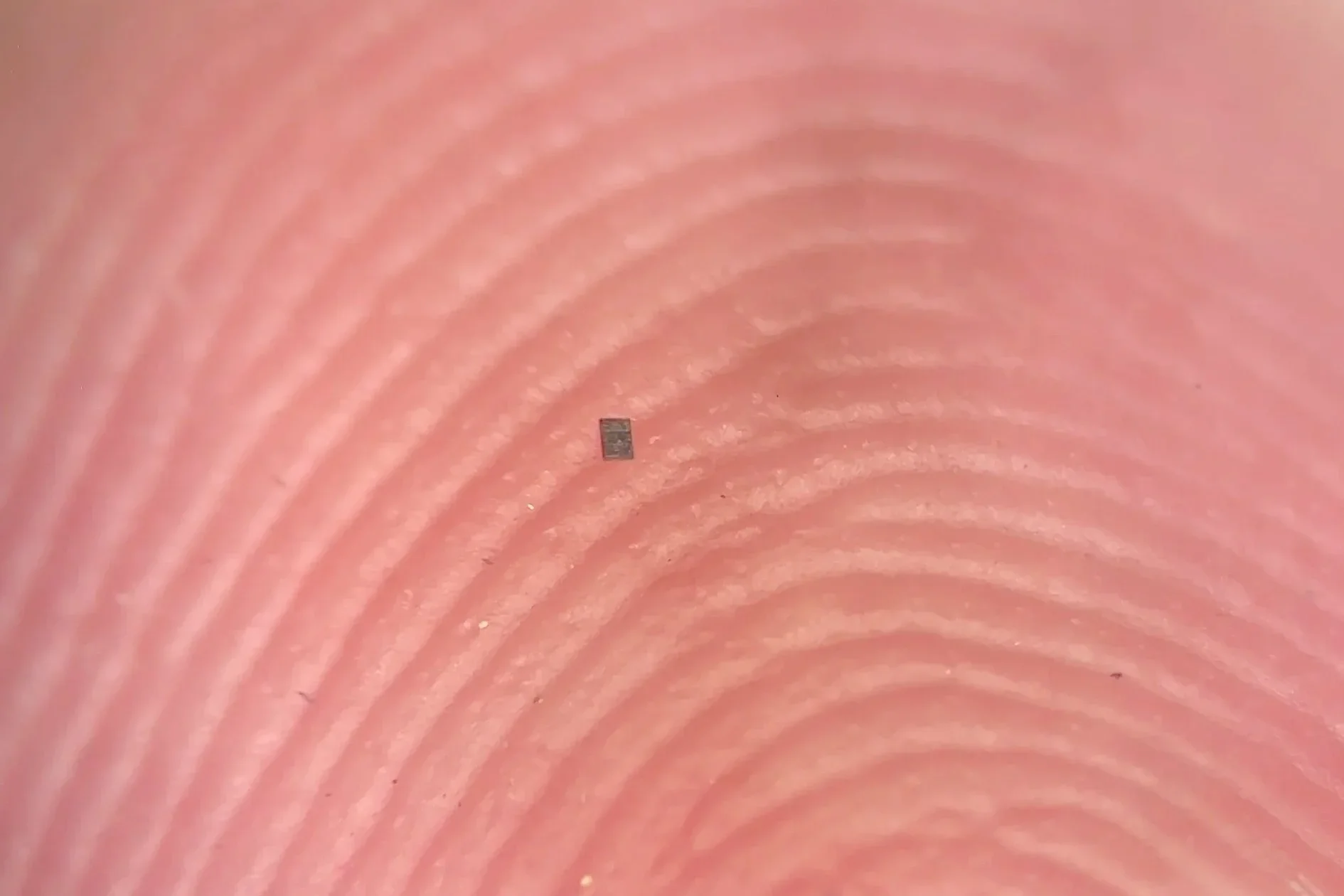

NANOTECNOLOGÍA Y ROBÓTICA

El futuro de nuestra interacción con los robots

Aun así, el sistema tiene limitaciones. Los autores reconocen que su modelo supone que las distintas modalidades —lenguaje, gesto y visión— son independientes, cuando en realidad suelen estar correlacionadas.

Además, el sistema depende de la calidad de la percepción visual. Si el robot detecta mal los objetos o interpreta mal el gesto, todo el razonamiento posterior se ve afectado.

Pero el avance ya apunta hacia una dirección clara: la robótica del futuro no dependerá solo de algoritmos más potentes, sino de robots capaces de interpretar la comunicación humana en toda su riqueza.

🗣️ «Este trabajo es un gran ejemplo de cómo podemos lograr una interacción entre humanos y máquinas más natural y eficaz fortaleciendo la colaboración entre la informática y las ciencias cognitivas —señala Ellie Pavlick, profesora de Informática en Brown. Y concluye—: Aprovechar lo que sabemos sobre cómo las personas quieren comunicarse de forma natural, y construir sistemas de inteligencia artificial alineados con esas intuiciones humanas, es el camino correcto a seguir».

Porque, como saben los perros desde hace miles de años, a veces un gesto dice más que mil palabras.▪️(14-marzo-2026)

PREGUNTAS&RESPUESTAS: Robots y Gestos Humanos

🤖 ¿Cómo pueden los robots entender gestos humanos?

Los robots utilizan sensores de visión y modelos probabilísticos para interpretar la dirección de un gesto, como señalar con la mano. En este estudio, el gesto se modela como un cono de probabilidad que indica la región donde probablemente se encuentra el objeto.

🤖 ¿Qué es un POMDP en robótica?

Un POMDP (proceso de decisión de Markov parcialmente observable) es un modelo matemático que permite a un robot tomar decisiones cuando no tiene información completa sobre el entorno.

🤖 ¿Por qué los perros inspiran esta investigación?

Los perros son especialmente buenos interpretando gestos humanos como señalar. Los investigadores utilizan ese comportamiento como modelo para diseñar robots que entiendan mejor las pistas humanas.

🤖 ¿Qué aplicaciones tendrá esta tecnología?

Puede aplicarse en:

robots domésticos

robots industriales

asistentes robóticos en hospitales

misiones de rescate

almacenes automatizados

Fuente: Ivy Xiao He, Stefanie Tellex, Jason Xinyu Liu. LEGS-POMDP: Language and Gesture-Guided Object Search in Partially Observable Environments. arXiv (2026). DOI: https://doi.org/10.48550/arXiv.2603.04705