IA y ecuaciones en derivadas parciales: el avance que permite resolver uno de los problemas matemáticos más difíciles

La inteligencia artificial da un salto inesperado al enfrentarse a uno de los retos más complejos de las matemáticas: las ecuaciones en derivadas parciales. Un nuevo enfoque basado en mejores fundamentos matemáticos —y no en más potencia de cálculo— promete descifrar fenómenos ocultos en sistemas tan diversos como el clima o el ADN.

Por Enrique Coperías, periodista científico

La inteligencia artificial lee las ondas visibles para reconstruir la causa oculta: una metáfora visual de cómo los nuevos métodos matemáticos permiten descifrar las ecuaciones invisibles que gobiernan el mundo. Crédito: IA-DALL-E-RexMolón Producciones

Las ecuaciones en derivadas parciales son, desde hace más de un siglo, uno de los lenguajes más sofisticados de la ciencia. Con ellas se describen fenómenos tan diversos como la propagación del calor, la dinámica de los fluidos o la formación de patrones en sistemas biológicos. Sin embargo, hay un tipo especialmente esquivo: las llamadas ecuaciones inversas, aquellas que obligan a los científicos a reconstruir causas invisibles a partir de efectos observables.

Ahora, los ingenieros Vinayak Vinayak, Ananyae Kumar Bhartari y Vivek Shenoy, de la Universidad de Pensilvania, en Estados Unidos, proponen una nueva forma de abordar este problema con inteligencia artificial (IA). Su apuesta no consiste en aumentar la potencia de cálculo, como ha sido habitual en los últimos años, sino en cambiar las matemáticas que hay detrás del proceso.

«Resolver un problema inverso es como mirar las ondas en un estanque e intentar deducir dónde cayó la piedra —explica Shenoy, autor senior del estudio—. Puedes ver claramente los efectos, pero el verdadero reto es inferir la causa oculta».

➡️ La IA no solo predice sistemas complejos, ahora puede reconstruir las causas ocultas a partir de los efectos observados

El trabajo, publicado en la revista Transactions on Machine Learning Research y que se presentará en la Conferencia sobre Sistemas de Procesamiento de Información Neural (NeurIPS 2026), introduce una herramienta llamada Mollifier Layers —capas apaciguadoras— que promete hacer más estable, eficiente y preciso el uso de la inteligencia artificial en matemáticas y problemas complejos.

¿Qué son las ecuaciones en derivadas parciales y por qué son importantes?

Las ecuaciones diferenciales permiten describir cómo cambian las cosas. Cuando incluyen varias dimensiones —espacio y tiempo— se convierten en ecuaciones en derivadas parciales (PDE), el pilar matemático de gran parte de la física, la ingeniería o la biología.

Pero los problemas inversos en ecuaciones en derivadas parciales plantean una pregunta más ambiciosa: en lugar de predecir qué ocurrirá, buscan reconstruir qué ha ocurrido.

Este enfoque tiene aplicaciones directas en campos tan distintos como la predicción meteorológica, la ciencia de materiales o la genética. En todos ellos, los científicos observan patrones —temperaturas, imágenes, concentraciones— y tratan de inferir los mecanismos que los generan.

Durante años, la inteligencia artificial aplicada a la ciencia ha empezado a desempeñar un papel crucial en este proceso mediante modelos conocidos como redes neuronales informadas por la física. Sin embargo, estos sistemas tienen un talón de Aquiles: la forma en que calculan derivadas.

El cuello de botella invisible

En apariencia, el problema es técnico. En la práctica, es fundamental.

Para resolver ecuaciones complejas, estos modelos necesitan calcular derivadas de orden superior, es decir, medir cómo cambian los cambios. Tradicionalmente lo hacen mediante un procedimiento llamado diferenciación automática.

Pero este método tiene efectos secundarios importantes: consume mucha memoria, es computacionalmente costoso y, sobre todo, se vuelve inestable cuando los datos contienen ruido.

Los propios investigadores lo ilustran con una metáfora: es como ampliar repetidamente una línea irregular. Cada ampliación no solo revela detalles, sino que también magnifica el ruido hasta distorsionar el resultado.

Ahí es donde surge la idea clave del trabajo.

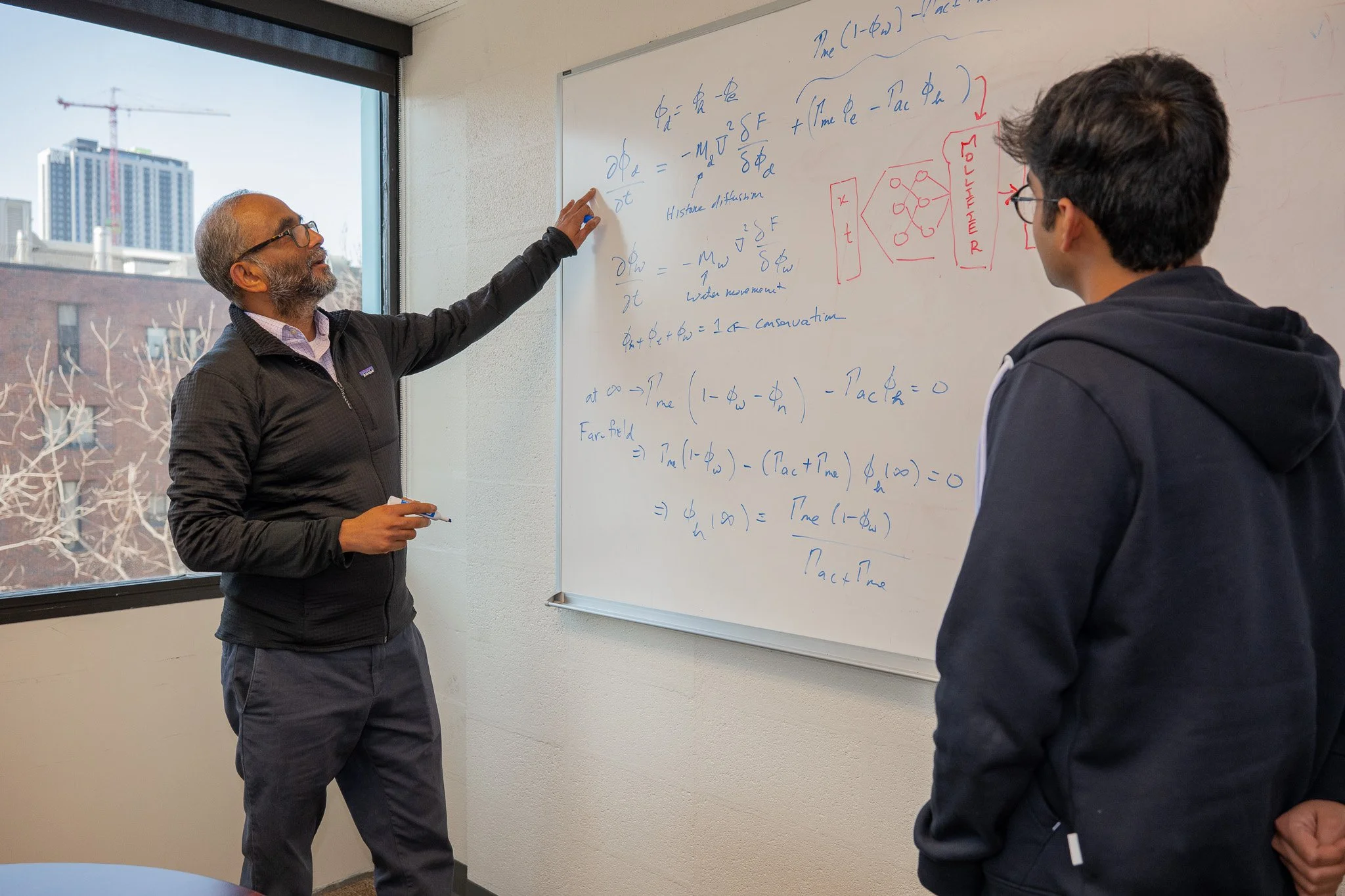

Vivek Shenoy (izquierda) explica en la pizarra los fundamentos matemáticos de las mollifier layers a Vinayak Vinayak (derecha), en una imagen que refleja el trabajo teórico detrás del avance en inteligencia artificial aplicada a ecuaciones complejas. Cortesía: Sylvia Zhang

Volver a las matemáticas para avanzar en IA

🗣️ «Hoy en día, la inteligencia artificial suele avanzar aumentando la escala del cómputo —señala Vinayak—. Pero algunos desafíos científicos requieren mejores matemáticas, no simplemente más potencia de cálculo».

En lugar de insistir en la diferenciación automática, el equipo recurrió a un concepto clásico: los mollifiers o apaciguadores, también conocidos como aproximaciones a la identidad, unas funciones matemáticas introducidas en los años cuarenta por Kurt Otto Friedrichspara suavizar señales irregulares.

La innovación consiste en integrar este principio en la arquitectura de los modelos de IA. En vez de calcular derivadas directamente dentro de la red neuronal, estas se obtienen mediante convoluciones matemáticas con funciones suavizadas previamente definidas.

El resultado es un cambio conceptual: la red ya no necesita derivar, sino que produce una función base que después se procesa de forma más estable.

🗣️ «Al principio pensábamos que el problema estaba en la arquitectura de la red neuronal —explica Bhartari, otra de las autoras principales del estudio. Y añade—: Pero tras ajustarla cuidadosamente, nos dimos cuenta de que el cuello de botella era la diferenciación automática recursiva en sí misma».

La solución: qué son las «Mollifier Layers»

Los resultados del estudio muestran mejoras notables. Las nuevas capas permiten calcular derivadas de orden superior de forma más precisa, incluso en presencia de ruido, y reducen de manera significativa el coste computacional.

En algunos experimentos, los modelos con Mollifier Layers logran multiplicar por diez la eficiencia en memoria y tiempo de entrenamiento, manteniendo o mejorando la precisión.

Así, las capas de apaciguadores permiten calcular derivadas de forma más estable. Pero ¿cómo?

✅ Sustituyen la diferenciación automática.

✅ Suavizan los datos antes de calcular cambios.

✅ Utilizan convoluciones matemáticas con funciones suaves.

✅ Separan el aprendizaje de la red del cálculo de derivadas

Además, el nuevo módulo matemático destaca especialmente en los casos más complejos, como ecuaciones de cuarto orden, donde los enfoques tradicionales tienden a fallar.

Aplicaciones reales: de la inteligencia artificial a la biología

Uno de los aspectos más interesantes del trabajo es su aplicación en biología.

El equipo lo ha utilizado para estudiar la organización de la cromatina, la estructura en la que se empaqueta el ADN dentro del núcleo celular. Este sistema está gobernado por procesos epigenéticos, esto es, reacciones químicas que regulan qué genes se activan o desactivan, que resultan extremadamente difíciles de medir e forma directa.

🗣️ «Durante años hemos utilizado estas ecuaciones para estudiar cómo se organiza la cromatina en células vivas —detalla Shenoy. Y continúa—: Pero siempre nos encontrábamos con el mismo problema: podíamos ver las estructuras y modelar su formación, pero no inferir de forma fiable los procesos epigenéticos que las generan».

Las nuevas capas permiten precisamente eso: deducir las tasas de reacción que controlan estos procesos a partir de imágenes de alta resolución.

Y las implicaciones son profundas.

«Estos dominios tienen apenas 100 nanómetros, pero determinan la expresión génica, y eso influye en la identidad celular, el envejecimiento y la enfermedad», señala Shenoy.

Hacia nuevas terapias

El potencial de esta herramienta no se limita a comprender mejor la biología, sino que podría abrir nuevas vías terapéuticas.

«Si podemos seguir cómo evolucionan estas tasas de reacción durante el envejecimiento, el cáncer o el desarrollo —añade Vinayak— se abre la posibilidad de nuevas terapias: si las tasas de reacción controlan la organización de la cromatina y el destino celular, modificarlas podría redirigir las células hacia estados deseados».

En otras palabras, la inteligencia artificial en medicina podría no solo describir procesos biológicos, sino intervenir en ellos.

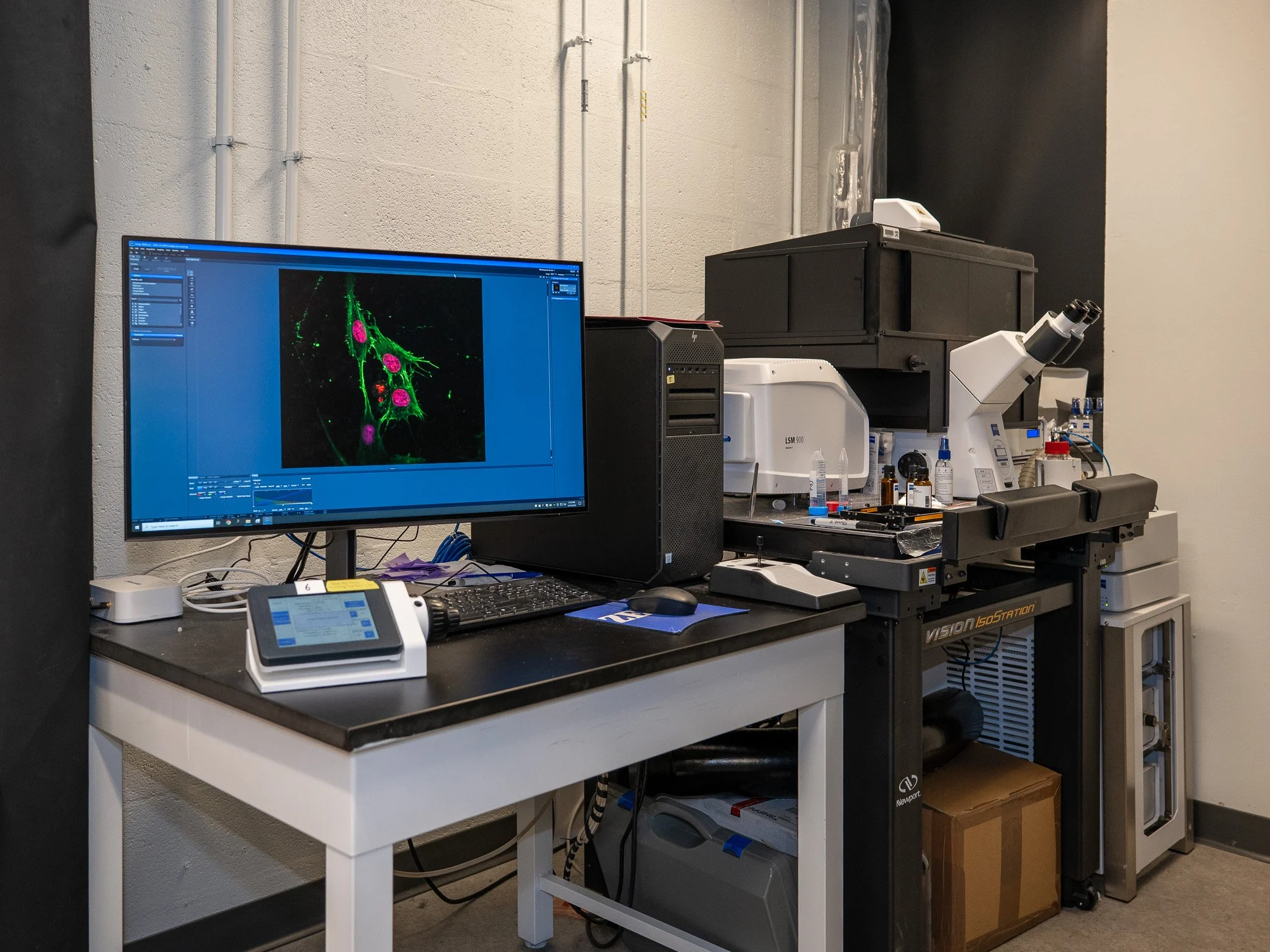

Gracias a las Mollifier Layers, el laboratorio de Shenoy puede inferir los factores ocultos que gobiernan procesos complejos como el plegamiento de la cromatina; en la pantalla, una muestra obtenida con el microscopio, a la derecha. Cortesía: Sylvia Zhang

Impacto en otras áreas científicas

Aunque el ejemplo de la cromatina es especialmente llamativo, los investigadores insisten en que el alcance del método es mucho mayor.

Las ecuaciones en derivadas parciales aparecen en prácticamente todos los ámbitos de la ciencia donde los problemas inversos son habituales y difíciles:

✅ Meteorología y predicción climática.

✅ Ingeniería de materiales.

✅ Física de fluidos.

✅ Simulación científica avanzada.

✅ Aprendizaje automático científico.

La nueva técnica podría ofrecer una forma más robusta y eficiente de abordarlos.

«El objetivo final es pasar de observar patrones complejos a descubrir cuantitativamente las reglas que los generan —resume Shenoy—. Si entiendes las reglas que gobiernan un sistema, entonces tienes la posibilidad de cambiarlo».

Hacia una IA que entiende las leyes del mundo

Este avance no es un salto espectacular en términos de potencia de cálculo ni un modelo más grande que los anteriores. Es, en cierto modo, algo más sutil: una reconsideración de las herramientas matemáticas que sustentan la inteligencia artificial.

En un momento en el que la IA parece avanzar principalmente por acumulación —más datos, más parámetros, más potencia—, este trabajo apunta en otra dirección: la de integrar mejor las matemáticas clásicas en los sistemas modernos.

Y sugiere algo importante: que algunos de los problemas más difíciles de la ciencia no se resolverán solo con más tecnología, sino con mejores ideas.

Porque, al fin y al cabo, entender el mundo sigue siendo, en esencia, un problema matemático.▪️(2-mayo-2026)

PREGUNTAS&RESPUESTAS: PDE e IA

♾️ ¿Qué son las ecuaciones en derivadas parciales (PDE) en inteligencia artificial?

Son ecuaciones matemáticas que describen cómo cambian variables en el espacio y el tiempo, utilizadas para modelar sistemas complejos.

♾️ ¿Qué es un problema inverso?

Es un método para inferir causas ocultas a partir de datos observables.

♾️ ¿Qué aporta la IA en este campo?

Permite resolver ecuaciones complejas y extraer parámetros ocultos con mayor precisión.

♾️ ¿Qué son las Mollifier Layers?

Son una técnica matemática que mejora el cálculo de derivadas mediante suavizado, haciendo los modelos más estables y eficientes.

♾️ ¿Por qué es importante este avance?

Porque permite resolver problemas científicos complejos con menos recursos y mayor precisión.

Información facilitada por la Penn Engineering - University of Pennsylvania

Fuente: Vinayak Vinayak, Ananyae K Bhartari y Vivek B Shenoy. Mollifier Layers: Enabling Efficient High-Order Derivatives in Inverse PDE Learning. Transactions on Machine Learning Research (TMLR)