El hábil robot humanoide que aprende a jugar al tenis a partir de los errores humanos: así funciona LATENT

Un robot humanoide ya es capaz de sostener pelotear con tenistas y aprender no de sus movimientos perfectos, sino de sus fallos. El sistema LATENT demuestra que la inteligencia artificial puede convertir datos imperfectos en habilidades deportivas sorprendentemente reales.

Por Enrique Coperías, periodista científico

Un robot humanoide Unitree G1 devuelve una pelota durante un peloteo, fruto del sistema LATENT, que le permite aprender tenis combinando fragmentos imperfectos de movimientos humanos y ajustarlos en tiempo real con inteligencia artificial. Cortesía: LATENT

En una pista de tenis, la escena resulta todavía desconcertante: un robot humanoide corre, se posiciona, ajusta el cuerpo y devuelve la pelota con un golpe que recuerda, de manera sorprendente, al de un jugador aficionado.

No es una coreografía preprogramada ni un truco de laboratorio. Es aprendizaje. Y, lo más llamativo, aprendizaje a partir de errores humanos.

Un equipo de investigadores de universidades chinas y laboratorios de inteligencia artificial (IA) ha desarrollado un sistema capaz de enseñar a robots humanoides a jugar al tenis utilizando datos imperfectos de nuestro movimiento. Zhikai Zhang, de la Universidad Tsinghua, en Pekín, y sus colegas proponen un enfoque que rompe con una de las ideas más asentadas en robótica: la necesidad de datos precisos y completos para entrenar máquinas complejas.

Por qué el tenis es uno de los mayores retos para la robótica

Durante años, uno de los grandes obstáculos para que los robots imiten habilidades deportivas ha sido la dificultad de capturar con exactitud el movimiento humano. El tenis, en particular, plantea un desafío extremo: desplazamientos rápidos por toda la pista, reacciones en milisegundos ante pelotas que pueden superar los 30 metros por segundo y una coordinación muy fina de muñeca en el instante del golpeo.

Frente a ese reto, los ingenieros chinos han optado por una solución contraintuitiva: renunciar a la perfección. En lugar de intentar registrar partidos completos con sistemas de captura de movimiento complejos y costosos, han recopilado fragmentos de movimientos básicos —golpes de derecha, de revés, pasos laterales— realizados por jugadores aficionados en un espacio reducido.

Esos datos son, por definición, incompletos e imprecisos. No contienen la secuencia completa de un punto de tenis ni capturan con exactitud todos los matices del gesto técnico. Pero ahí reside la clave del avance: aunque imperfectos, esos fragmentos contienen lo esencial, una especie de gramática motora del tenis humano.

«Los nuevos datos proporcionan pistas sobre las habilidades primitivas», explican los autores.

EL ROBOT «ALCARAZ»

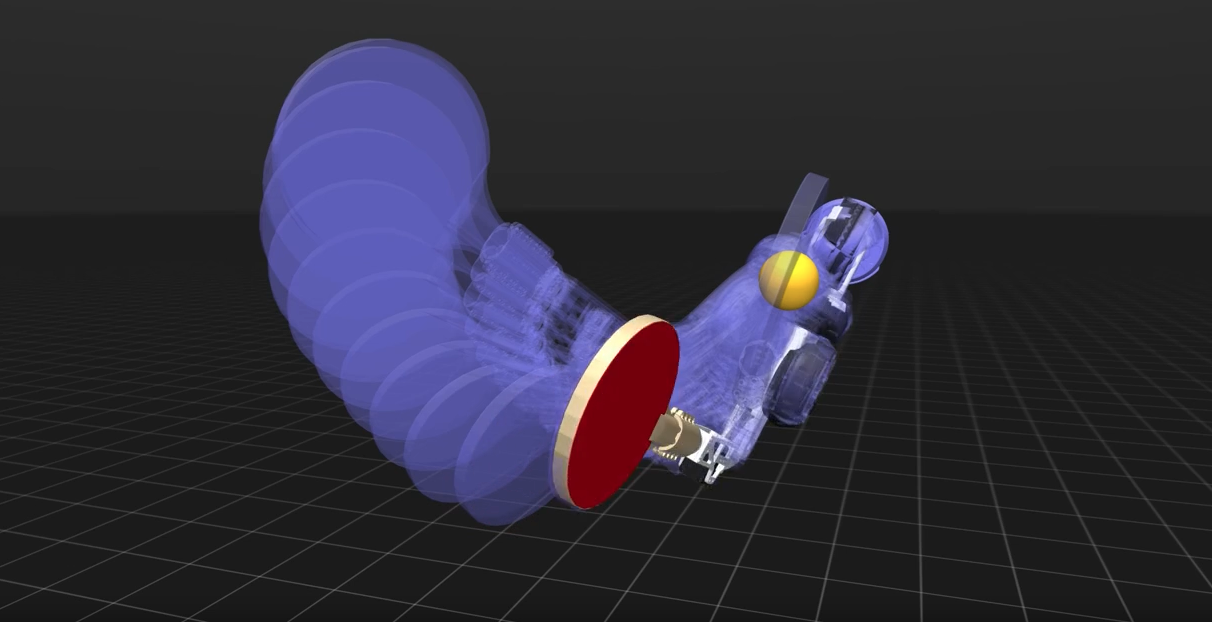

LATENT es un sistema de aprendizaje para robots humanoides que permite

adquirir habilidades deportivas complejas utilizando datos humanos

incompletos e imprecisos.

Qué es LATENT

El sistema desarrollado, llamado LATENT, se basa en una idea que recuerda a cómo aprenden las personas: no copiando exactamente cada movimiento, sino combinando patrones básicos y adaptándolos a cada situación. En este caso, el robot no memoriza jugadas completas, sino que construye su comportamiento a partir de piezas más simples:

1️⃣ Primero, el sistema aprende a imitar esos fragmentos de movimiento mediante un modelo de control que traduce los datos humanos a las articulaciones del robot.

2️⃣ Después, condensa esas habilidades en un espacio latente: una representación matemática que permite combinar y modificar los movimientos de forma flexible.

3️⃣ Finalmente, entra en juego el aprendizaje por refuerzo, una técnica de inteligencia artificial en la que el robot aprende mediante prueba y error.

El sistema recibe recompensas cuando consigue devolver la pelota correctamente y penalizaciones cuando falla, ajustando progresivamente su comportamiento.

El resultado es un robot capaz de decidir en tiempo real qué combinación de movimientos utilizar, corrigiendo además los errores inherentes a los datos iniciales.

Uno de los aspectos más delicados es el control de la muñeca, fundamental en el tenis. Los datos recogidos no capturan bien ese detalle, por lo que el sistema introduce una capa adicional de control que permite al robot ajustar de forma independiente ese gesto fino sin comprometer el equilibrio del resto del cuerpo.

Del simulador al mundo real

Como ocurre con muchos avances en robótica, el entrenamiento se realiza inicialmente en controladores. Allí, el robot virtual puede practicar millones de veces en condiciones controladas. Sin embargo, trasladar ese aprendizaje al mundo real, el llamado problemasim-to-real, es uno de los mayores desafíos del campo.

Para salvar esa brecha, los investigadores introducen variaciones aleatorias en la simulación: cambian ligeramente la masa del robot, la fricción del suelo, la resistencia del aire o el comportamiento de la pelota. También añaden ruido a las observaciones, simulando errores de percepción.

La idea es que el robot no aprenda un entorno perfecto, sino uno lleno de incertidumbre, más parecido al mundo real. Así, cuando finalmente se transfiere el sistema a un robot físico —en este caso, un modelo Unitree G1—, este es capaz de adaptarse mejor a las condiciones reales.

Y funciona. En los experimentos, el robot logra mantener intercambios de varias jugadas con jugadores humanos, devolviendo pelotas a distintas zonas de la pista y utilizando tanto golpes de derecha como de revés.

El robot humanoide Unitree G1 ejecuta intercambios de varias jugadas con un jugador humano, adaptando distintos golpes según la posición en pista (izquierda), y responde a pelotas lanzadas a gran velocidad con movimientos coordinados y precisos (derecha). Cortesía: Zhikai Zhang et al.

Un gran salto en la robótica deportiva

Los resultados cuantitativos son llamativos, según Zhang. En simulación, el sistema alcanza tasas de éxito superiores al 96% en algunos escenarios, muy por encima de métodos anteriores. Y en el mundo real, aunque la precisión disminuye, como es lo habitual, el robot consigue devolver la pelota dentro de la pista en la mayoría de los intentos.

Más allá de las cifras, lo relevante es la calidad del movimiento. Los investigadores destacan que el robot no solo cumple la tarea, sino que lo hace de forma natural, evitando movimientos bruscos o poco realistas.

Este aspecto es crucial. Durante años, muchos sistemas de aprendizaje automático han conseguido resultados funcionales pero con comportamientos poco elegantes o físicamente inverosímiles. Aquí, en cambio, el robot mantiene un estilo de movimiento cercano al humano, gracias a esas prioridades extraídas de los datos imperfectos.

A RAQUETAZO LIMPIO

El robot androide ha demostrado realizar una alta tasa de

devoluciones dentro de pista.

Robots que aprenden como nosotros

El enfoque tiene implicaciones que van más allá del tenis. Tradicionalmente, el desarrollo de robots humanoides ha dependido de datos de alta calidad, difíciles y costosos de obtener. Este trabajo sugiere que no es necesario aspirar a la perfección: basta con capturar lo esencial y dejar que el sistema complete el resto mediante aprendizaje.

Es una idea profundamente humana. Las personas no aprenden deportes observando cada detalle con precisión milimétrica, sino practicando, cometiendo errores y refinando habilidades básicas. El robot, en cierto modo, hace lo mismo.

Además, el sistema podría aplicarse a otras disciplinas donde los datos completos son difíciles de conseguir, como el fútbol, el parkour o incluso tareas industriales complejas.

Límites y próximos pasos

Pese a los avances, el sistema aún está lejos de competir con un jugador profesional. El entorno experimental simplifica algunos aspectos del juego, y el robot depende de sistemas de captura de movimiento externos para percibir su posición y la de la pelota.

Los autores señalan como futura línea de trabajo la incorporación de visión artificial, lo que permitiría al robot jugar sin necesidad de una infraestructura externa.

También plantean el uso de entrenamiento multiagente, donde varios robots aprendan compitiendo entre sí, una técnica que ha demostrado ser eficaz en otros ámbitos de la inteligencia artificial.

Una nueva forma de enseñar a las máquinas

El logro de este trabajo no es solo técnico, sino conceptual. Demuestra que la imperfección —tradicionalmente vista como un obstáculo— puede convertirse en una ventaja. Al trabajar con datos incompletos, el sistema se ve obligado a generalizar, a encontrar patrones, a construir soluciones más flexibles.

En un momento en que la inteligencia artificial avanza hacia sistemas cada vez más autónomos y adaptativos, esta idea resulta especialmente relevante. Quizá el futuro de la robótica no pase por replicar con exactitud el comportamiento humano, sino por capturar su esencia y permitir que las máquinas la reinventen.

En la pista, mientras tanto, el robot sigue devolviendo pelotas. No lo hace como un campeón, pero tampoco como una máquina torpe. Se mueve, corrige, aprende. Y en cada golpe hay algo más que ingeniería: hay una nueva forma de entender cómo aprenden las máquinas.▪️(20-marzo-2026)

PREGUNTAS&RESPUESTAS: Robots y Tenis

🏸 ¿Puede un robot aprender tenis sin datos perfectos?

Sí. Este estudio demuestra que datos incompletos son suficientes si se combinan con aprendizaje por refuerzo.

🏸 ¿Qué es un espacio latente en robótica?

Es una representación matemática que permite combinar habilidades básicas para generar movimientos complejos.

🏸 ¿Por qué es importante el aprendizaje por refuerzo?

Porque permite al robot mejorar mediante prueba y error, adaptándose a nuevas situaciones.

🏸 ¿Qué significa sim-to-real?

Es el proceso de transferir lo aprendido en simulación al mundo real.

Fuente: Zhikai Zhang et al. Learning Athletic Humanoid Tennis Skills from Imperfect Human Motion Data. arXiv (2026). DOI: https://doi.org/10.48550/arXiv.2603.12686